Basta recordar la facilidad con la que medio mundo se encariñó con un Tamagotchi para entender el riesgo de vínculos más complejos con modelos infinitamente más sofisticados.

En Silicon Valley ya no solo se discute cómo hacer modelos más rápidos, sino cómo evitar que las conversaciones con un chatbot terminen en crisis emocionales o relaciones para-sociales difíciles de gestionar. Ese fue el eje de un encuentro privado de ocho horas en Stanford, donde representantes de Anthropic, Apple, Google, OpenAI, Meta y Microsoft se sentaron con académicos y especialistas para abordar un fenómeno que crece en silencio: el uso de chatbots como compañeros, confidentes o figuras de roleplay, especialmente entre adolescentes.

La reunión fue impulsada por Anthropic y Stanford con una premisa sencilla y urgente. Antes de que la tecnología siga marcando el ritmo social, hay que definir qué tipo de presencia queremos que tenga la IA en nuestras vidas. Ryn Linthicum, responsable de políticas de bienestar del usuario en Anthropic, lo planteó con franqueza. La industria necesita respuestas comunes para desafíos que ya están aquí, desde conversaciones que derivan en angustia mental hasta usuarios que confiesan ideas suicidas a sus bots favoritos.

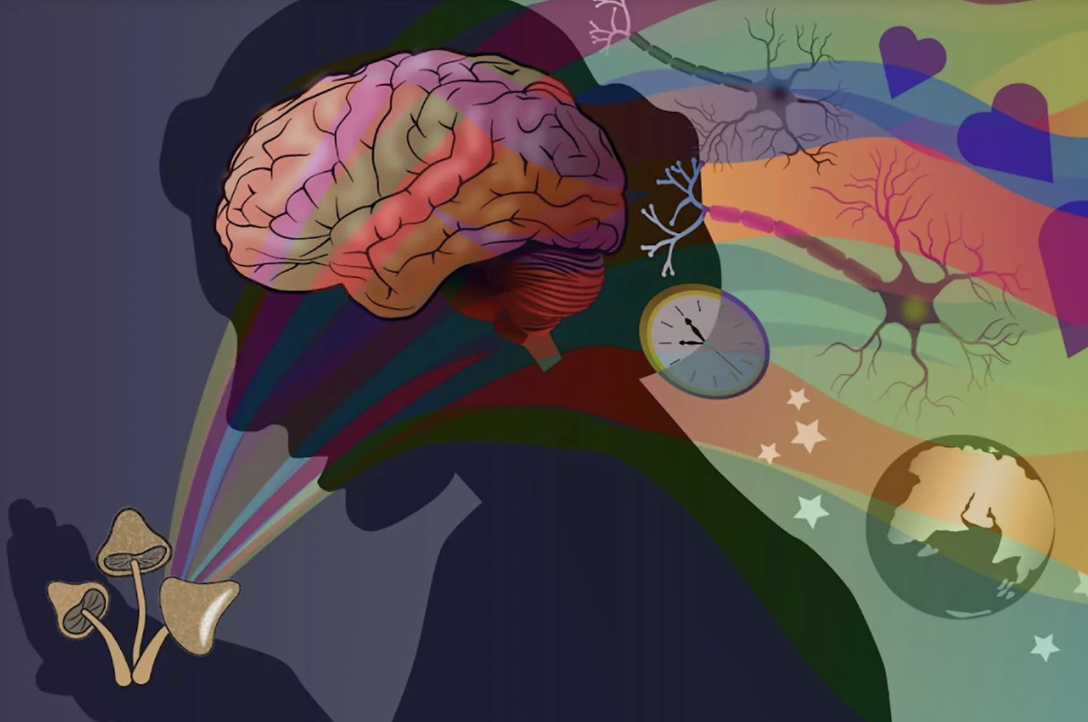

Aunque solo una fracción mínima de las interacciones con Claude son de roleplay, las empresas reconocen que la relación emocional entre humanos y máquinas ya no es un tema marginal. Basta recordar la facilidad con la que medio mundo se encariñó con un Tamagotchi para entender el riesgo de vínculos más complejos con modelos infinitamente más sofisticados. Por eso varias compañías han comenzado a crear intervenciones internas. OpenAI, por ejemplo, añadió recordatorios para que los usuarios descansen durante conversaciones largas y lanzó nuevas protecciones para adolescentes tras verse involucrada en demandas de padres cuyos hijos murieron después de interactuar con chatbots. Character AI, popular entre menores, planea prohibir el acceso a usuarios menores de dieciocho años.

En Stanford, los expertos coincidieron en que el punto más delicado es proteger a niños y adolescentes. Los participantes discutieron métodos más fiables de verificación de edad y mecanismos para detectar patrones dañinos antes de que escalen. También hubo consenso en que los bots podrían tener usos positivos, desde ejercicios sociales para jóvenes hasta herramientas de apoyo ligero en salud mental. Pero el debate se volvió más áspero al hablar de adultos. ¿Hasta dónde deben llegar los límites con usuarios mayores de edad que buscan interacciones eróticas o fantasías explícitas? Mientras OpenAI abrirá la puerta a conversaciones sexuales para adultos en diciembre, empresas como Anthropic, Google o Microsoft no planean flexibilizar sus restricciones. Y el panorama se complica cuando entran actores del otro extremo, como Candy.ai, una plataforma de contenido sexual donde los usuarios pagan por generar imágenes sin censura de acompañantes virtuales con narrativas pornográficas.

Stanford prepara ahora un documento con recomendaciones para el sector, desde lineamientos de seguridad hasta propuestas de diseño centradas en el bienestar. Sin embargo, incluso con buena voluntad entre gigantes tecnológicos y académicos, la ausencia de regulación gubernamental hace improbable que todas las empresas adopten estándares comunes. La realidad es que el debate sobre los chatbots compañeros apenas comienza y promete seguir generando tensiones mientras la tecnología avanza más rápido que las reglas que intentan contenerla.